@basecampbernie

↗

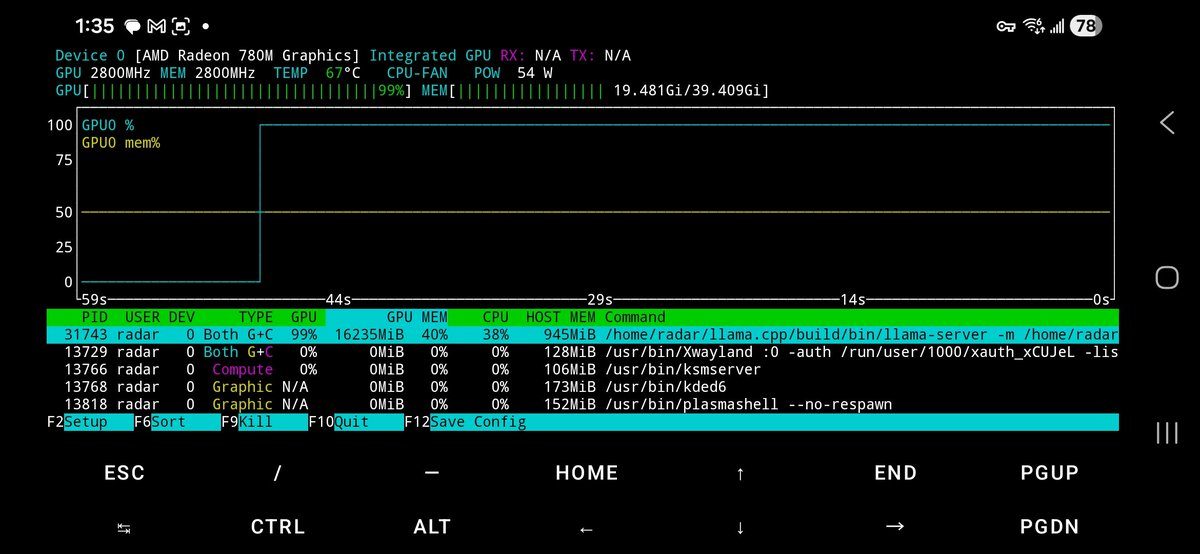

$300 mini PC running 26B parameter AI models at 20 tok/s. Minisforum UM790 Pro ($351) + AMD Radeon 780M iGPU + 48GB DDR5-5600 + 1TB NVMe. The secret: the 780M has no dedicated VRAM. It shares your DDR5 via unified memory. The BIOS says "4GB VRAM" but Vulkan sees the full pool.

RAM GPU accessible via Vulkan/GTT

▲40 GB

sur 64GB DDR5 installés

Limite affichée par le BIOS

4 GB

limite logicielle, pas physique

Débit sur Qwen3 26B

▲20 tok/s

à 65W de consommation

- 01

Préparer le BIOS

Au démarrage, entre dans le BIOS et alloue le maximum autorisé au GPU (généralement 4 ou 8GB selon le firmware). Ce n'est pas le plafond réel, juste la valeur initiale que Vulkan va dépasser via GTT. Sauvegarde et redémarre sous Linux. - 02

Installer llama.cpp avec support Vulkan

Clone et compile avec le backend Vulkan activé :git clone https://github.com/ggerganov/llama.cpp cd llama.cpp cmake -B build -DGGML_VULKAN=ON cmake --build build --config Release -j$(nproc)Vérifie que Vulkan détecte bien le 780M :

./build/bin/llama-cli --list-devicesTu dois voir le Radeon 780M listé avec une VRAM reportée bien supérieure aux 4GB du BIOS.

- 03

Télécharger un modèle MoE quantifié

Les modèles denses ne passent pas à 20 tok/s sur ce hardware. Il faut du MoE. Deux options testées par la communauté :- Qwopus3.5-27B TurboQuant TQ3_4S : quantification TurboQuant spécifiquement optimisée pour hardware limité

- PolarQuant Gemma : collection Gemma4 quantifiée pour iGPU AMD

huggingface-cli download YTan2000/Qwopus3.5-27B-v3-TQ3_4S \ --local-dir ./models/qwopus-27b - 04

Lancer l'inférence avec offload GPU maximum

./build/bin/llama-server \ --model ./models/qwopus-27b/model.gguf \ --n-gpu-layers 99 \ --ctx-size 8192 \ --host 0.0.0.0 \ --port 8080Le flag

--n-gpu-layers 99force llama.cpp à offloader le maximum de layers vers le 780M. GTT prend le relais au-delà de l'allocation BIOS. Surveille la RAM système pendant le chargement : tu verras le GPU grignoter bien au-delà des 4GB affichés. - 05

Connecter à ton client ou agent

Le serveur expose une API compatible OpenAI surhttp://localhost:8080. Tu peux le brancher directement à n'importe quel client qui supporte une base URL custom : Open WebUI, Continue.dev, ou ton propre code.from openai import OpenAI client = OpenAI( base_url="http://localhost:8080/v1", api_key="local" ) response = client.chat.completions.create( model="qwopus-27b", messages=[{"role": "user", "content": "Hello"}] )

huggingface.co↗

Qwopus3.5-27B TurboQuant TQ3_4S

Modèle 27B quantifié avec l'algorithme TurboQuant, optimisé pour hardware à mémoire unifiée limitée.