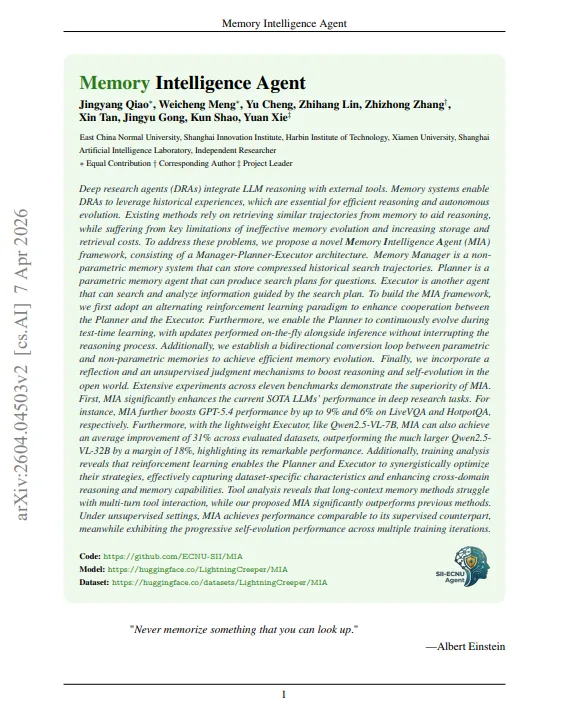

Le Memory Intelligence Agent, sorti d'East China Normal University et du Shanghai AI Lab, affiche des benchmarks deep research au-dessus de Gemini-2.5-Pro, GPT-4o et GPT-5.4, avec 7 milliards de paramètres. Sans réentraînement. Sans nouvelles données.

Ce que MIA fait concrètement

La plupart des agents de recherche repartent de zéro à chaque query. MIA stocke l'historique de recherche pendant l'inférence, en temps réel, et l'exploite activement pour les requêtes suivantes.

Le modèle n'interroge pas un index externe figé. Il accumule ce qui a fonctionné et ce qui a échoué au cours de la session, et ajuste ses stratégies de recherche en conséquence. Un analyste humain qui, après trois recherches infructueuses, change d'angle plutôt que de relancer les mêmes requêtes, fait exactement ça.

Le paper arXiv 2604.04503 décrit une architecture en trois composants : un module de mémoire à court terme (la session en cours), un module de consolidation (ce qui mérite d'être réutilisé), et un orchestrateur qui décide quand puiser dans la mémoire accumulée plutôt que de relancer une recherche brute.

Pourquoi le résultat est crédible

Les claims "7B bat GPT-5.4" circulent tous les mois. La plupart s'évaporent au premier regard sur la méthodologie. Ici, quelques éléments tiennent.

Les auteurs sont affiliés à East China Normal University, Harbin Institute of Technology et le Shanghai AI Lab, trois institutions avec un track record solide sur les agents LLM. Le paper est sur arXiv. Et la comparaison est restreinte à un domaine précis : le deep research, des tâches multi-étapes qui nécessitent d'agréger des informations depuis plusieurs sources.

Sur ce type de tâche, un 7B avec mémoire d'inférence bien architecturée peut dépasser un généraliste 200B. Les grands modèles généralistes ne sont pas optimisés pour l'accumulation de contexte inter-requêtes : ils gèrent bien des tâches variées, mais une stratégie de recherche adaptative demande autre chose.

Ce que ça change pour un builder qui déploie des agents

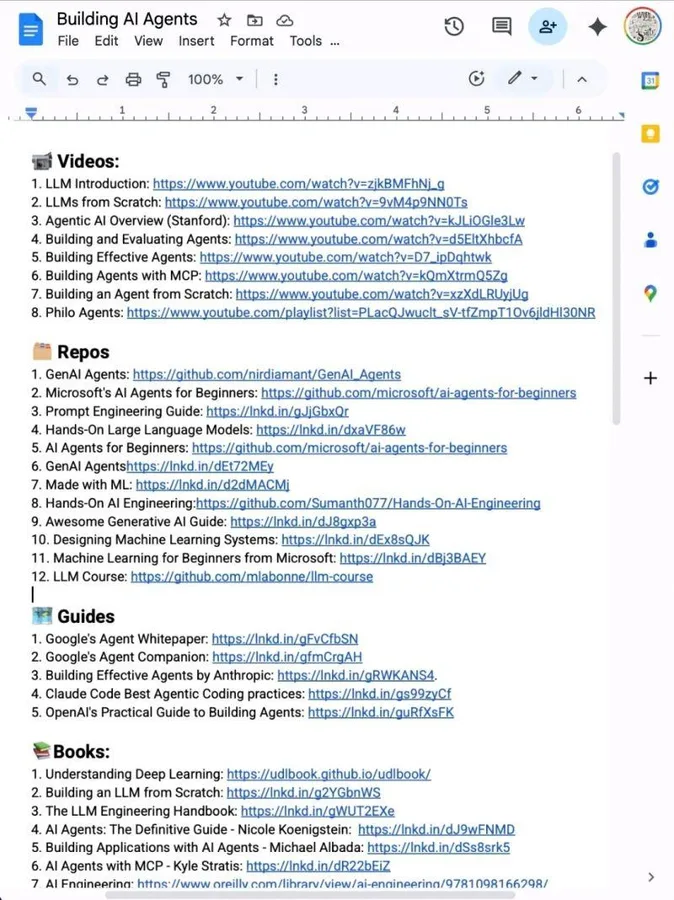

Si tu construis un agent de recherche aujourd'hui, tu as probablement résolu le problème de la mémoire via RAG sur un index vectoriel, context window étendu, ou réentraînement sur tes données. Les trois ont des coûts réels : latence, infrastructure, ou temps.

L'approche MIA ouvre une quatrième voie : la mémoire d'inférence, sans index à maintenir et sans fine-tuning. Tu gardes un modèle de base léger (7B tourne sur du matériel raisonnable), tu branches le module de mémoire, et le modèle s'améliore au fil de la session.

On avait creusé une approche voisine avec MemPalace, qui stocke localement les décisions et contextes entre sessions. MIA pousse la logique plus loin en rendant la mémoire active pendant l'inférence.

La limite évidente : la mémoire est intra-session et ne persiste pas entre deux runs. Pour un agent de recherche qui tourne en batch overnight, c'est un vrai problème que le paper n'adresse pas directement.

Le pattern qui se confirme

C'est le troisième paper en deux mois qui montre qu'un modèle spécialisé sous 10B paramètres dépasse des généralistes 10 à 30 fois plus grands sur une tâche précise. Le même pattern était apparu avec Leanstral sur la preuve formelle Lean4. La spécialisation architecturale compense massivement la taille.

Pour les builders, ça veut dire quelque chose de concret : le choix du modèle de base n'est plus le seul levier. L'architecture autour du modèle, et en particulier la gestion de la mémoire à l'inférence, est devenu un avantage compétitif réel. Un 7B bien architecturé déployé sur ta propre infra coûte une fraction d'un appel GPT-5.4, et peut faire mieux sur les tâches pour lesquelles tu l'as optimisé.

Le paper complet : arXiv 2604.04503. Les sections 3 et 4 sur l'architecture mémoire sont les plus denses, et les plus utiles.