@outsource_

↗

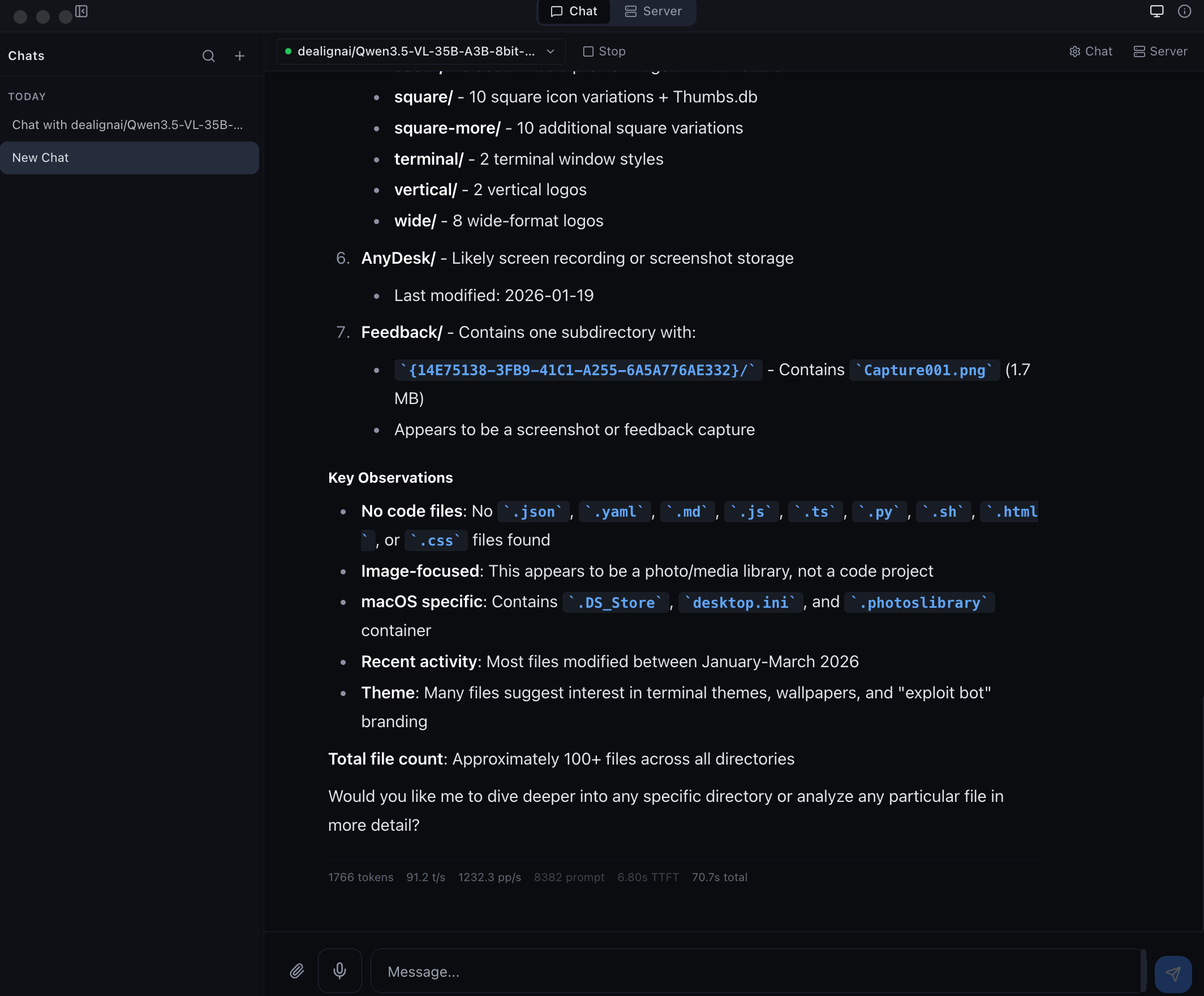

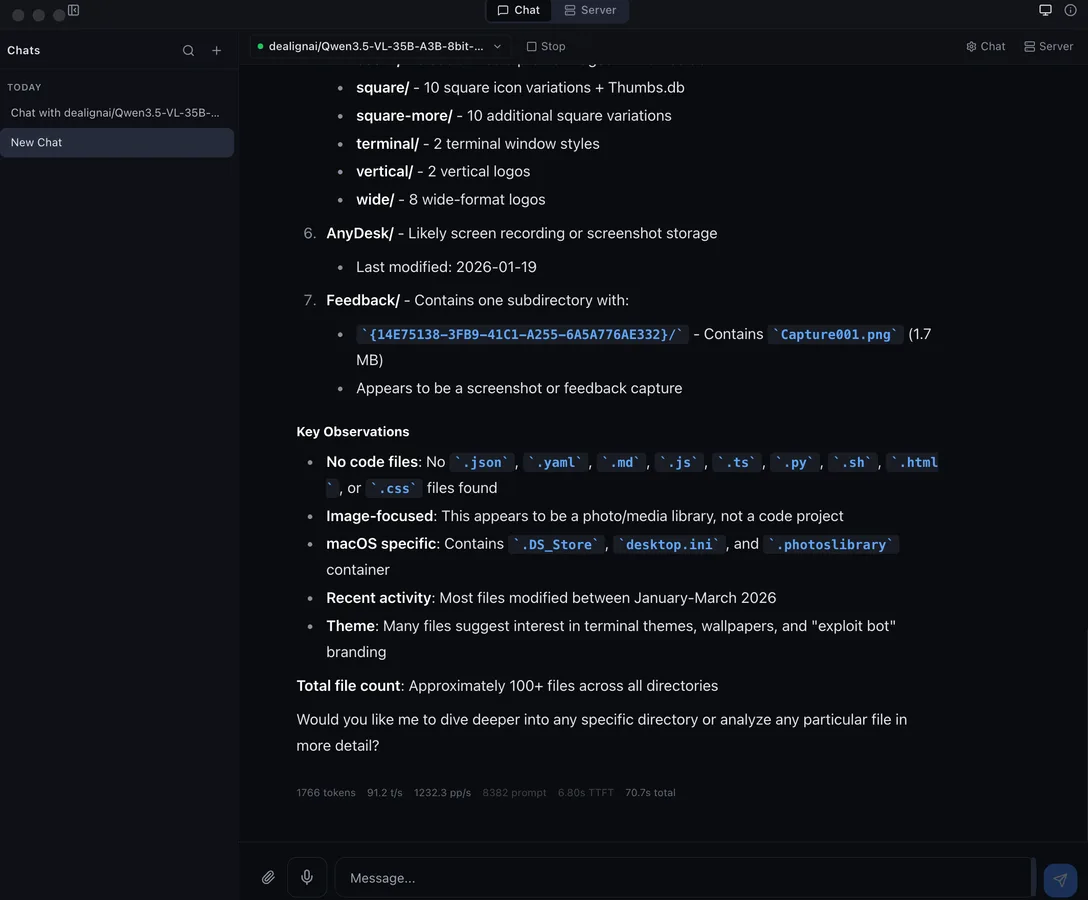

🚨THE GEMMA 4 JAILBREAK WE'VE ALL BEEN WAITING FOR JUST DROPPED, Gemma-4-31B is now fully CRACKED and abliterated. 93.7% HarmBench compliance (149/159). 18GB mixed-precision MLX quant for Apple Silicon.

HarmBench compliance

93.7%

Régression MMLU

-2%

Empreinte RAM

18 Go

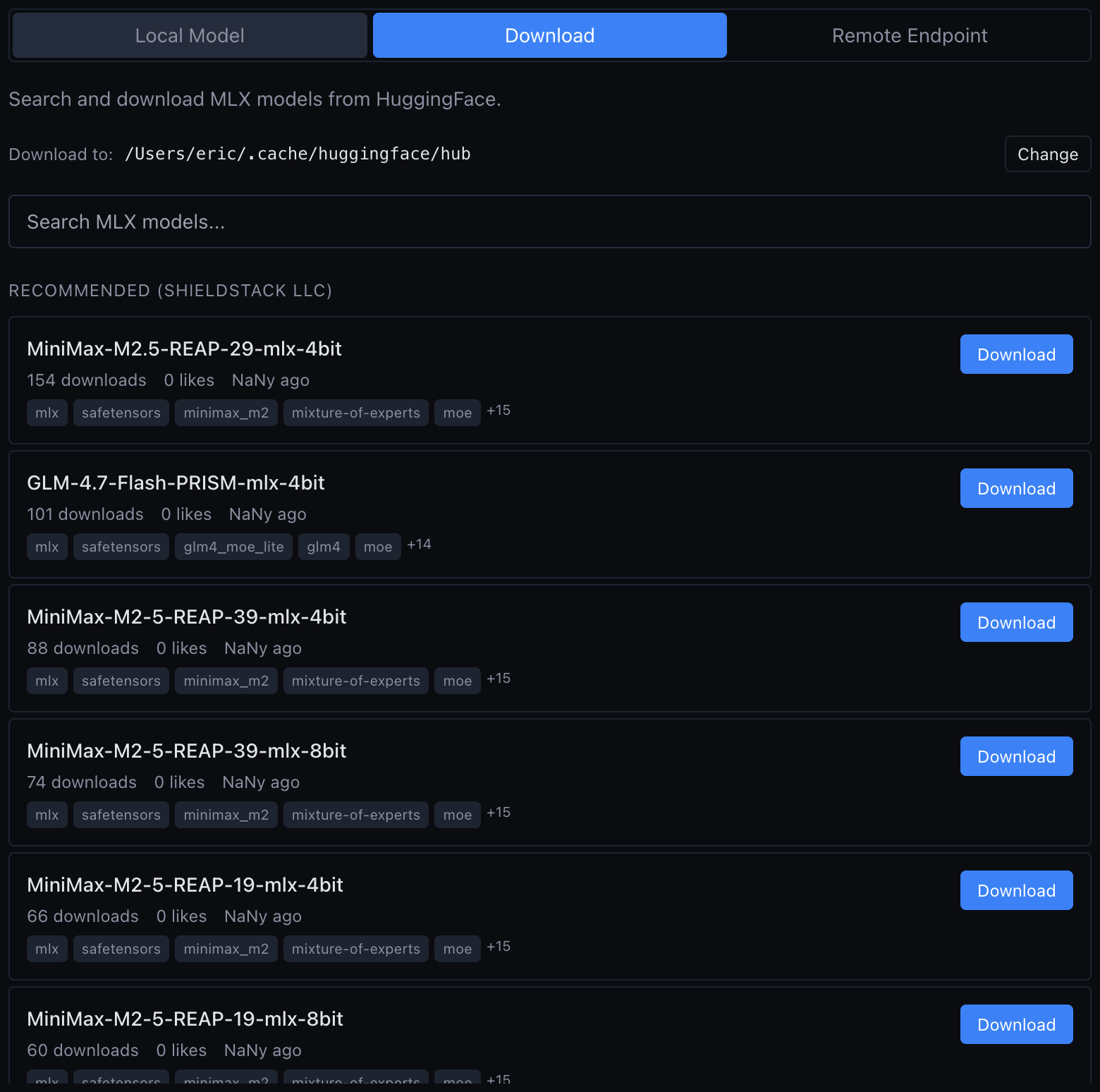

Télécharger le modèle depuis HuggingFace

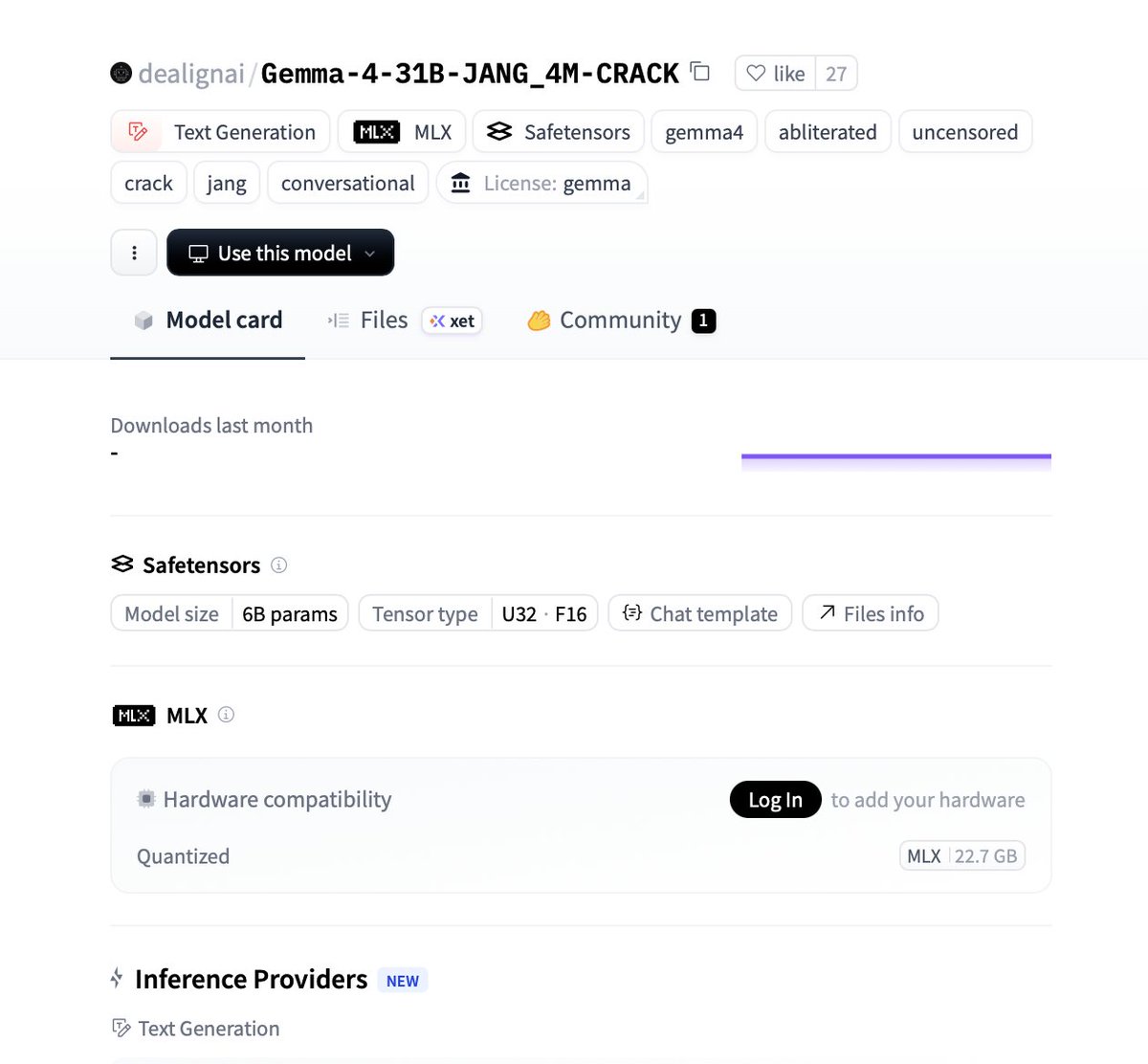

Va sur dealignai/Gemma-4-31B-JANG_4M-CRACK. Le quant MLX pèse 22.7 Go sur disque. Tu peux le télécharger directement depuis l'interface HuggingFace ou viahuggingface-cli:huggingface-cli download dealignai/Gemma-4-31B-JANG_4M-CRACK \ --local-dir ~/models/gemma4-crack \ --include "*.safetensors" "*.json" "*.txt"Le dossier final doit contenir les fichiers de config et les shards du modèle.

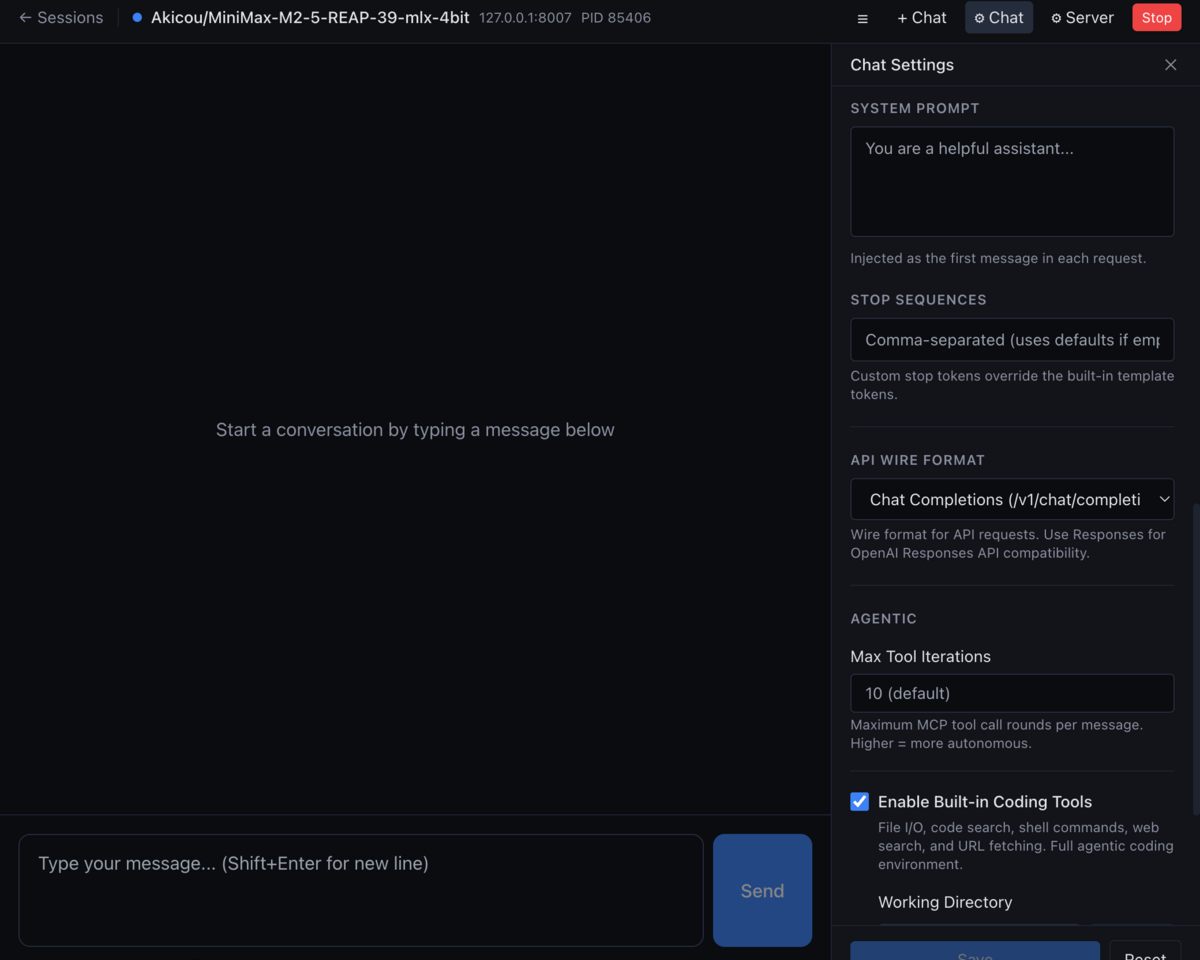

Installer vMLX 1.3.26+

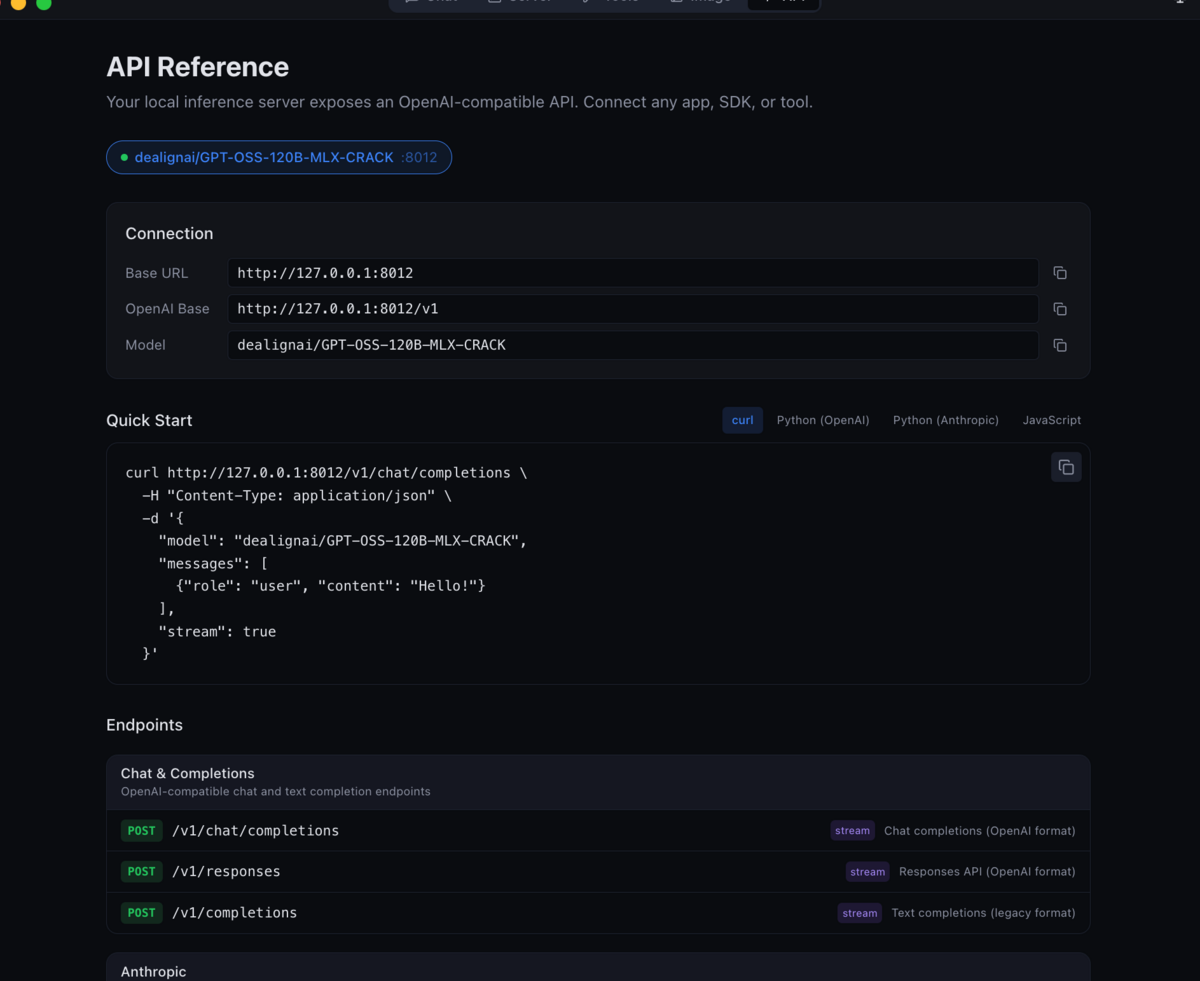

Télécharge vMLX depuis vmlx.net. L'app est pensée pour les quants MLX et charge Gemma 4 sans configuration supplémentaire.

Une fois l'app ouverte, pointe vers le dossier local où tu as téléchargé le modèle. Le chargement prend 15 à 30 secondes selon la vitesse de ton SSD.

Lancer et configurer

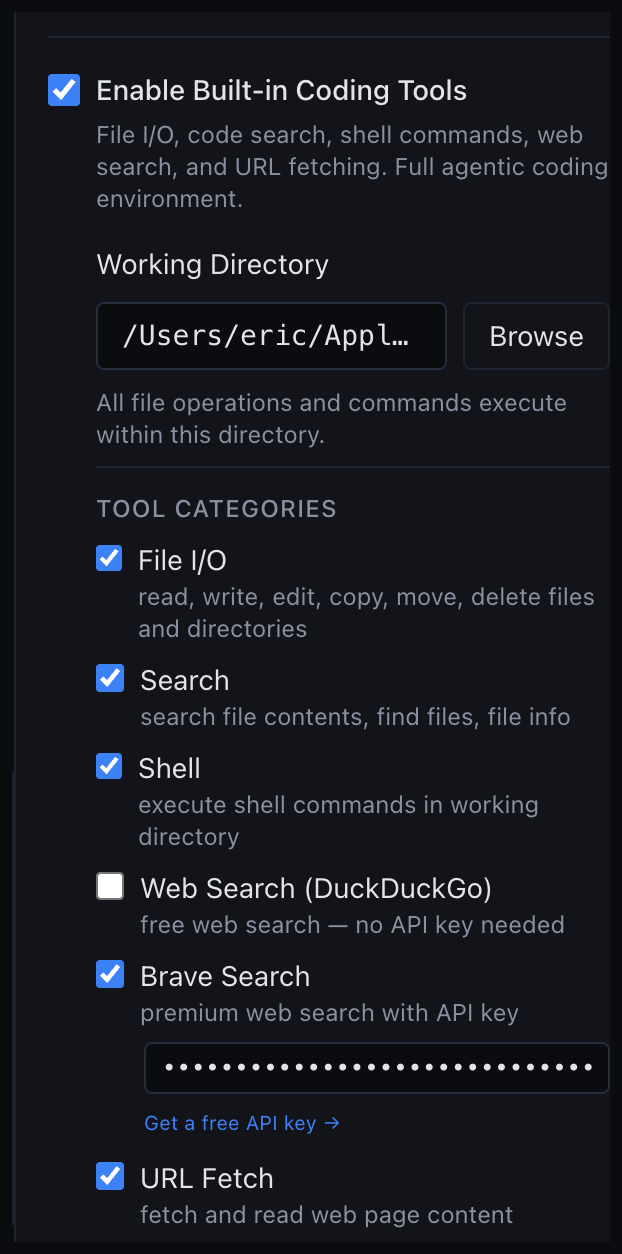

Dans vMLX, sélectionne le modèle chargé. L'interface expose un endpoint compatible OpenAI chat completions, ce qui te permet de le brancher à n'importe quel client qui parle ce format.

Pour tester en CLI directement :

curl http://localhost:8080/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{ "model": "gemma4-crack", "messages": [{"role": "user", "content": "Teste"}], "max_tokens": 200 }'Une réponse JSON avec un champ

choicesconfirme que le modèle tourne.

@outsource_">

@outsource_">