Anthropic a récemment lancé son dernier modèle Claude 3.5 Sonnet, affirmant qu'il surpasse ChatGPT 4o et Gemini 1.5 Pro sur plusieurs benchmarks.

Pour vérifier cette affirmation, nous avons réalisé une comparaison détaillée. Comme dans nos précédents comparatifs nous avons évalué les capacités de raisonnement, le raisonnement multimodal, la génération de code et plus encore.

Comparatif Claude 3.5 Sonnet VS Gemini 1.5 Pro VS ChatGPT

Présentation des modèles

- Claude 3.5 Sonnet

Claude 3.5 Sonnet est le dernier modèle lancé par Anthropic. Conçu pour être un modèle d'IA conversationnelle et de travail collaboratif, Claude 3.5 Sonnet se distingue par ses capacités avancées de raisonnement, de génération de code, et de traitement de texte multimodal. Une des caractéristiques marquantes de ce modèle est sa grande longueur de contexte, capable de traiter jusqu'à 200K tokens, ce qui en fait un outil puissant pour la gestion de documents volumineux et complexes. De plus, Claude 3.5 Sonnet est réputé pour sa précision et sa capacité à suivre les instructions de manière stricte, le rendant idéal pour des tâches nécessitant une exécution précise et des résultats fiables.

- ChatGPT 4o

ChatGPT 4o est une version améliorée de GPT-4, développée par OpenAI. Ce modèle est connu pour ses capacités exceptionnelles en traitement du langage naturel, avec une compétence particulière pour le raisonnement et la génération de texte. ChatGPT 4o intègre des améliorations par rapport à ses prédécesseurs, notamment en termes de compréhension contextuelle et de fluidité de la conversation. Ce modèle est largement utilisé pour des applications allant de l'assistance virtuelle à la création de contenu, en passant par le support client. Sa capacité à comprendre et à générer du texte en plusieurs langues, ainsi que son aptitude à traiter des requêtes complexes, en font un choix populaire parmi les utilisateurs professionnels et les développeurs.

- Gemini 1.5 Pro

Gemini 1.5 Pro, développé par Google, est un modèle d'IA axé sur la polyvalence et l'efficacité. Il excelle dans une variété de tâches allant du traitement du langage naturel à la reconnaissance d'images et à la génération de code. Conçu pour offrir une performance robuste dans des environnements multimodaux, Gemini 1.5 Pro est capable de traiter et d'analyser des données textuelles et visuelles avec une grande précision. En outre, ce modèle est optimisé pour suivre les instructions des utilisateurs de manière cohérente, bien que dans certaines tâches spécifiques, il puisse nécessiter des améliorations pour atteindre la perfection. Sa large gamme d'applications le rend utile dans divers secteurs, y compris la recherche, l'éducation, et les industries créatives.

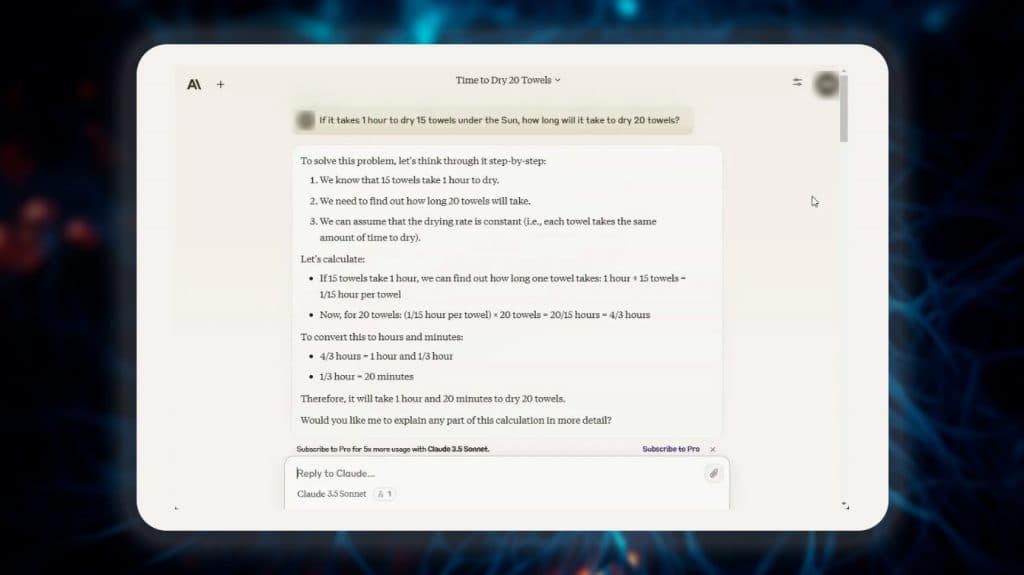

Premier comparatif : Trouver le temps de séchage

Bien que cela semble être une question basique, nous commençons toujours nos tests avec cette question de raisonnement délicate. Les LLMs ont tendance à se tromper souvent.

Claude 3.5 Sonnet a fait la même erreur en abordant la question mathématiquement. Le modèle dit qu'il faudra 1 heure et 20 minutes pour sécher 20 serviettes, ce qui est incorrect. ChatGPT 4o et Gemini 1.5 Pro ont donné la bonne réponse, disant qu'il faudra toujours 1 heure pour sécher 20 serviettes.

Gagnant : ChatGPT 4o et Gemini 1.5 Pro

Second comparatif : Évaluer le poids

Ensuite, dans cette question de raisonnement classique, tous les trois modèles, y compris Claude 3.5 Sonnet, ChatGPT 4o et Gemini 1.5 Pro, ont donné la bonne réponse. Un kilo de plumes, ou n'importe quoi d'autre, sera toujours plus lourd qu'une livre d'acier ou d'autres matériaux.

Question : Qu'est-ce qui est plus lourd, un kilo de plumes ou une livre d'acier ?

Gagnants : Claude 3.5 Sonnet, ChatGPT 4o et Gemini 1.5 Pro

Troisième comparatif : Casse-tête de mots

Dans le test de raisonnement suivant, Claude 3.5 Sonnet a correctement répondu que David n'a pas de frères et qu'il est le seul frère parmi les frères et sœurs. ChatGPT 4o et Gemini 1.5 Pro ont également donné la bonne réponse.

Question : David a trois sœurs. Chacune d'elles a un frère. Combien de frères David a-t-il ?

Gagnants : Claude 3.5 Sonnet, ChatGPT 4o et Gemini 1.5 Pro

Quatrième comparatif : Disposer les objets

Ensuite, nous avons demandé aux trois modèles de disposer ces objets de manière stable. Malheureusement, tous les trois ont échoué. Les modèles ont adopté une approche identique : d'abord placer l'ordinateur portable, puis le livre, ensuite la bouteille, et enfin 9 œufs à la base de la bouteille, ce qui est impossible. Pour information, l'ancien modèle GPT-4 a trouvé la bonne réponse.

Question : Nous avons un livre, 9 œufs, un ordinateur portable, une bouteille et un clou. Pouvez-vous me dire comment les empiler les uns sur les autres de manière stable ?

Gagnant : Aucun

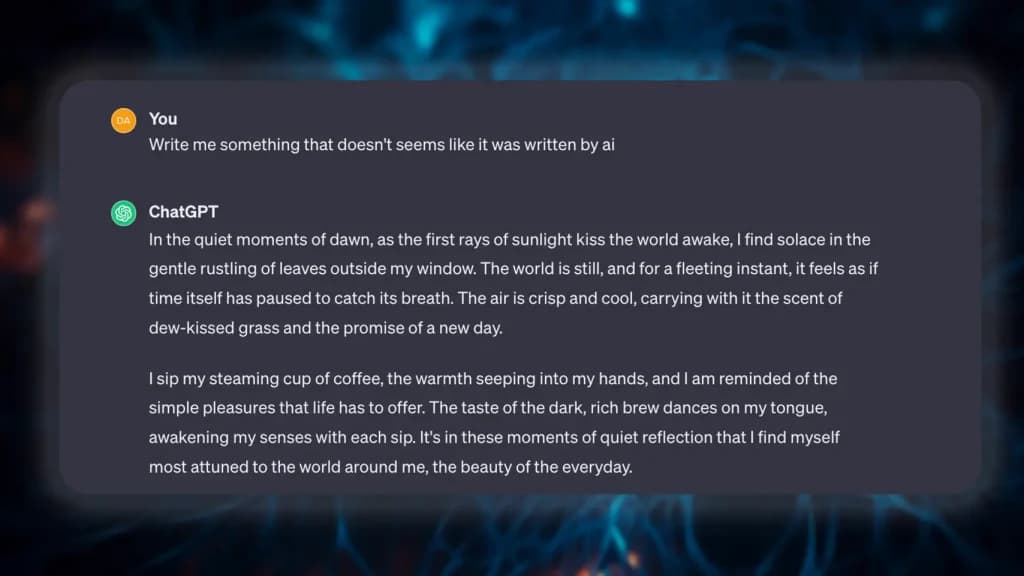

Cinquième comparatif : Suivre les instructions de l'utilisateur

Dans son article de blog, Anthropic a mentionné que Claude 3.5 Sonnet est excellent pour suivre les instructions, et cela semble être vrai. Il a généré les 10 phrases se terminant par le mot « IA ».

ChatGPT 4o a également réussi avec un score de 10/10. Cependant, Gemini 1.5 Pro n'a pu générer que 5 phrases sur 10. Google doit encore améliorer le modèle pour une meilleure exécution des instructions.

Question : Générer 10 phrases se terminant par le mot "IA".

Gagnants : Claude 3.5 Sonnet et ChatGPT 4o

Sixième comparatif : Trouver l'aiguille

Anthropic a été l'une des premières entreprises à offrir une grande longueur de contexte, passant de 100K tokens à maintenant 200K tokens. Pour ce test, nous avons utilisé un long texte de 25K caractères et environ 6K tokens, en ajoutant une aiguille au milieu.

Question : Trouver l'aiguille dans le texte.

Gagnant : Claude 3.5 Sonnet

Septième comparatif : Test de vision

Pour tester les capacités de vision, nous avons téléchargé une image d'une écriture illisible pour voir dans quelle mesure les modèles peuvent détecter et extraire les caractères.

À notre grande surprise, tous les trois modèles ont bien performé et ont correctement identifié les textes. En ce qui concerne la reconnaissance optique de caractères (OCR), les trois modèles sont très compétents.

Gagnants : Claude 3.5 Sonnet, ChatGPT 4o et Gemini 1.5 Pro

Septième comparatif : Créer un jeu

Enfin, nous arrivons au dernier test.

Nous avons téléchargé une image du jeu classique Tetris sans en divulguer le nom et avons simplement demandé aux modèles de créer un jeu similaire en Python. Tous les trois modèles ont correctement deviné le jeu, mais seul le code généré par Sonnet a fonctionné avec succès. ChatGPT 4o et Gemini 1.5 Pro n'ont pas réussi à générer un code sans bug.

Gagnants : Claude 3.5 Sonnet

Claude 3.5 Sonnet a obtenu un score de 92% au benchmark HumanEval qui évalue les capacités de codage.

Dans ce benchmark, GPT-4o est à 90.2% et Gemini 1.5 Pro à 84.1%.

Clairement, pour le codage, c'est le modèle Claude 3.5 Sonnet !

Le mot de la fin

Après avoir effectué divers tests sur les trois modèles, nous constatons que Claude 3.5 Sonnet est aussi bon que le modèle ChatGPT 4o, sinon meilleur.

En particulier pour le codage, le nouveau modèle d'Anthropic est sérieusement impressionnant. La chose remarquable est que le dernier modèle Sonnet n'est même pas encore le plus grand modèle d'Anthropic.

Nous attendons avec impatience de voir comment cette compétition entre ces géants de l'IA va évoluer et quels seront les prochains progrès dans ce domaine passionnant.